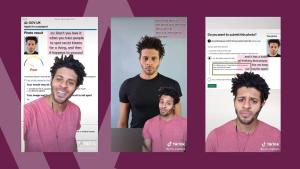

TikToker Joris Lechêne erzählte in einem Video, dass seine Passfotos vom System einer britischen Behörde nicht angenommen wurden, weil die Gesichtserkennungstechnologie ihn nicht identifizieren konnte. Der TikToker mit 81.000 FollowerInnen sagte, dass der Algorithmus seine Fotos als inakzeptabel wertete, weil "sein Mund offen sein könnte" und "sein Bild und der Hintergrund zu schwer zu unterscheiden sind."

Für dich ausgesucht

Problematische Gesichtserkennung

Lechêne, der Schwarz ist, teilte die Fotos, die er in der Passbehörde gemacht hat. Die Bilder zeigen ihn mit geschlossenem Mund und vor einem hellgrauen Hintergrund stehend – seine Gesichtszüge wären damit unschwer zu erkennen. Zudem betonte er, dass er alle Regeln eingehalten hat, die für die Fotos vorgeschrieben wären.

In dem Video argumentiert der TikToker, dass der Gesellschaft gesagt wird, dass solche Programme Diskriminierung verhindern könnten, doch es sei genau das Gegenteil der Fall. "Nur, weil unter anderem meine Haare nicht perfekt um mein Gesicht fallen", betonte der TikToker sarkastisch, der darauf anspielte, dass das System eher Frisuren von Weißen Menschen erkannte. Doch auch als er ein Bild von einem Schwarzen Mann benutze, der abrasierte Haare hatte, konnte das System die Person nicht erkennen.

Joris ist der Meinung, dass die Algorithmen dieser Systeme viel mehr Rücksicht auf Schwarze Menschen nehmen sollten. "Roboter sind genauso rassistisch wie unsere Gesellschaft", sagte der User in seinem Video. Die fehlende Diversität, die in der Gesellschaft und solchen Programmen herrscht, kann laut Joris vor allem durch politischen Aktivismus bekämpft werden.

Für dich ausgesucht

Rassistische Snapchat-Filter

Wie "Vice" 2020 berichtete, gab es große Aufregung um eine Anti-Schummel-Software an der Miami Universität, die in 50 Prozent der Fälle die Gesichter von People of Color (PoC) nicht erkennen konnte. Das belastete die StudentInnen, die dadurch Angst hatten, ihre Prüfungen nicht bestehen oder abgeben zu können. 2016 hieß es in einem Bericht von "refinery29", dass sogar einige Snapchat-Filter bei Schwarzen UserInnen nicht funktionierten, weil das System sie nicht erkannte.